ISO ex machina

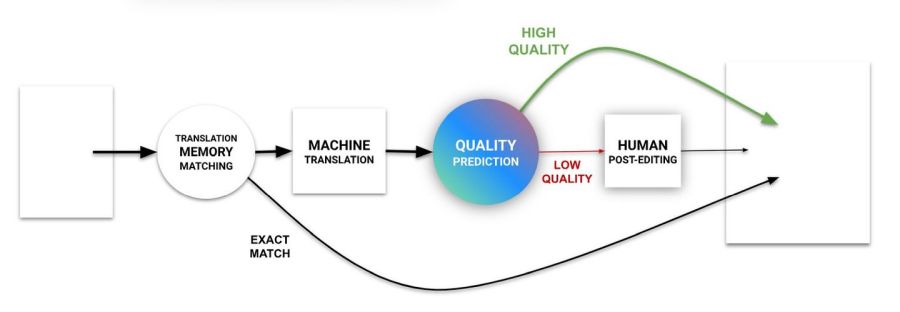

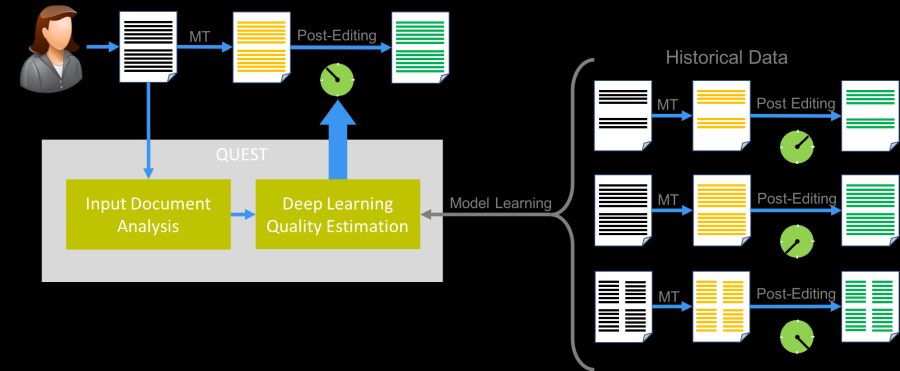

Ciekawe, czy uda się wdrożyć wróżenie jakości MT, które będzie dobrze skorelowane z faktyczną jakością MT ocenioną przez człowieka – czyli tekst postedytowany (zgodnie z wróżbą “tu trzeba”) i tekst niepostedytowany (zgodnie z wróżbą “nie trzeba”) będą nie do odróżnienia przez korektę/redakcję, zwłaszcza pod względem merytorycznym. Koncepcję objaśnia Adam Bittlingmayer, dyrektor firmy ModelFront zajmującej się – a jakże – wróżeniem jakości MT, w artykule dla tcworld.info:

“A quality prediction score should correlate with the decision of a professional human translator to edit or not edit a segment in a given translation workflow. (…) The most important question is whether humans can even tell the difference between the final output of the new process and the old process.“

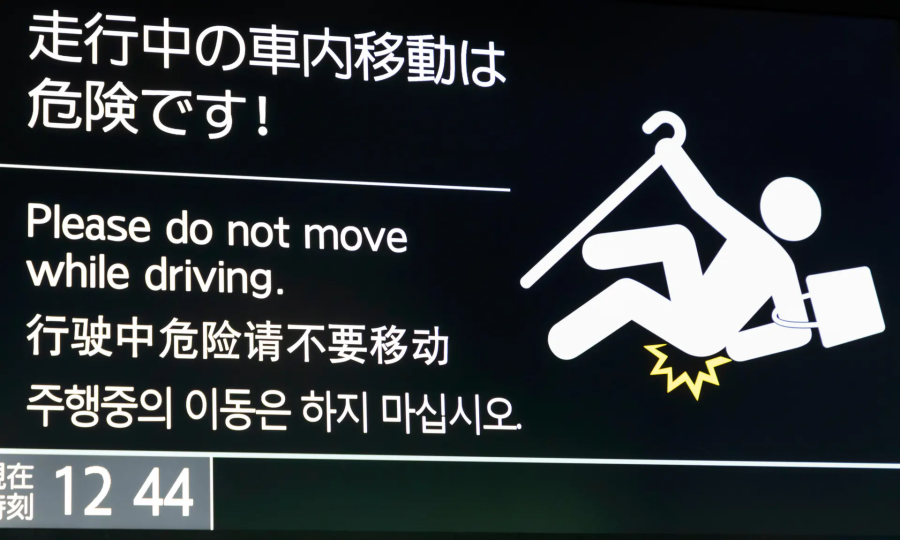

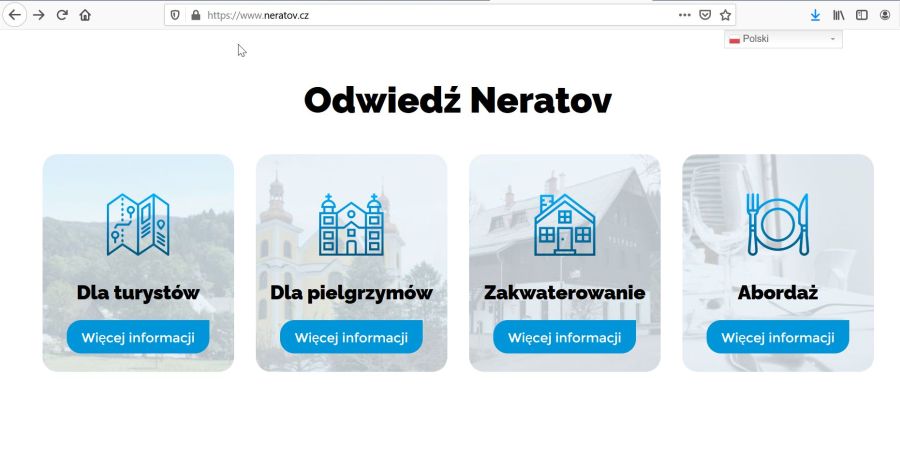

Przyznam, że chciałabym, żeby rozwój MTPE poszedł w kierunku “porządna postedycja za porządne stawki albo publikujemy surowe MT”, a nie w stronę dalszego obniżania stawek za PE i podnoszenia oczekiwanej wydajności postedycji, bo zbliżamy się chyba do granicy możliwości człowieka w zakresie przetwarzania informacji; dalej będzie już tylko pozorowanie sprawdzania, nieetycznie nie tylko z powodu przerzucania odpowiedzialności na tłumaczy, ale przede wszystkim ze względu na wprowadzanie konsumentów w błąd, że tłumaczenie jest zgodne merytorycznie z oryginałem i że ktoś za to odpowiada. A ponieważ postedytorami bywamy, a konsumentami jesteśmy – chciałabym jeszcze tylko przepisu, np. normy ISO, który wymusi oznaczanie wszelkich publikowanych tekstów jako “raw MT”, jeśli postedycji nie było, przy czym postedycja powinna być zdefiniowana jako pełna w rozumieniu normy ISO 18587 (“to obtain a product comparable to a product obtained by human translation”), a koncepcja “light PE” należy czym prędzej wyprowadzić za stodołę i zastrzelić.