“Maratony MT” to bardzo praktyczne konferencje: nie uświadczy się tam marketingu rynkowych produktów MT, tylko prezentacje projektów naukowo-badawczych, często w toku, przy czym badacze są i ze środowisk komercyjnych, i akademickich. Do tego popołudniami toczą się mini-projekty, które posuwają naprzód rozwiązywanie konkretnych problemów. Do tego postery z projektów bardziej niszowych (np. sieć neuronowa oceniająca jakość tłumaczenia poezji, uwzględniająca – oprócz dokładności tłumaczenia – rymy i rytm). Do tego dużo czasu (i kawy) na dyskusje w kuluarach. Do tego Praga, bo gospodarzem tegorocznego MTM był Uniwersytet Karola, a cała impreza jest bezpłatna. Wady? Bardzo wysoki poziom naukowy i techniczny, bez wektorów i logarytmów ani rusz!

A co zwróciło moją uwagę od strony praktycznej:

- Środowiska komercyjne (Google, Microsoft) i naukowe (WMT) zgodnie przyjęły Multidimensional Quality Metric za standard oceny MT przez ludzi – zastępując zbyt uproszczoną ocenę segmentów w skali od 0 do 5. MQM polega na klasyfikacji błędów (sens, terminologia, gramatyka itd.) oraz ich ważności (krytyczny, poważny, taki sobie) – czyli jest metodą doskonale znaną tłumaczom i weryfikatorom, a przy tym pozwalającą ocenić przydatność MT do danego zastosowania (czasem ważniejszy jest płynny język i przecinki, a kiedy indziej dokładność i terminologia).

- 90% prac naukowych z dziedziny MT i tak stosuje wyłącznie miary automatyczne, ale są prowadzone badania sprawdzające, jakie miary najlepiej pokrywają się z oceną przez ludzi. W skrócie: COMET > BERT >> BLEU.

- Kierunki prac naukowo-badawczych określiłabym jako “the usual suspects”:

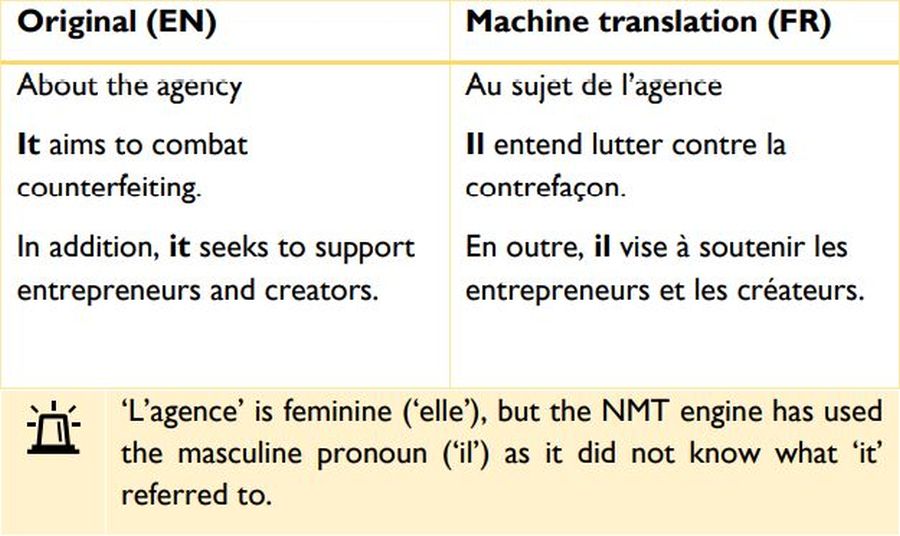

- kontekst, najlepiej całego dokumentu, a jak nie, to chociaż poprzednie i następne zdanie (są nowości, nie ma przełomu, ale przynajmniej wszyscy przyznają, że bez tego ani rusz);

- automatyczne przewidywanie jakości MT, czy to w formie “samooceny” przez silnik, czy też oddzielnej sieci neuronowej do oceniania propozycji maszynowych (dobrym pomysłem jest używanie danych z MQM do trenowania systemów automatycznego oceniania);

- modele wielojęzyczne, zwłaszcza w kontekście “podciągania” MT dla języków o słabo dostępnych zasobach treningowych (islandzki) przez zgrupowanie z językami o dużych zasobach (niemiecki).